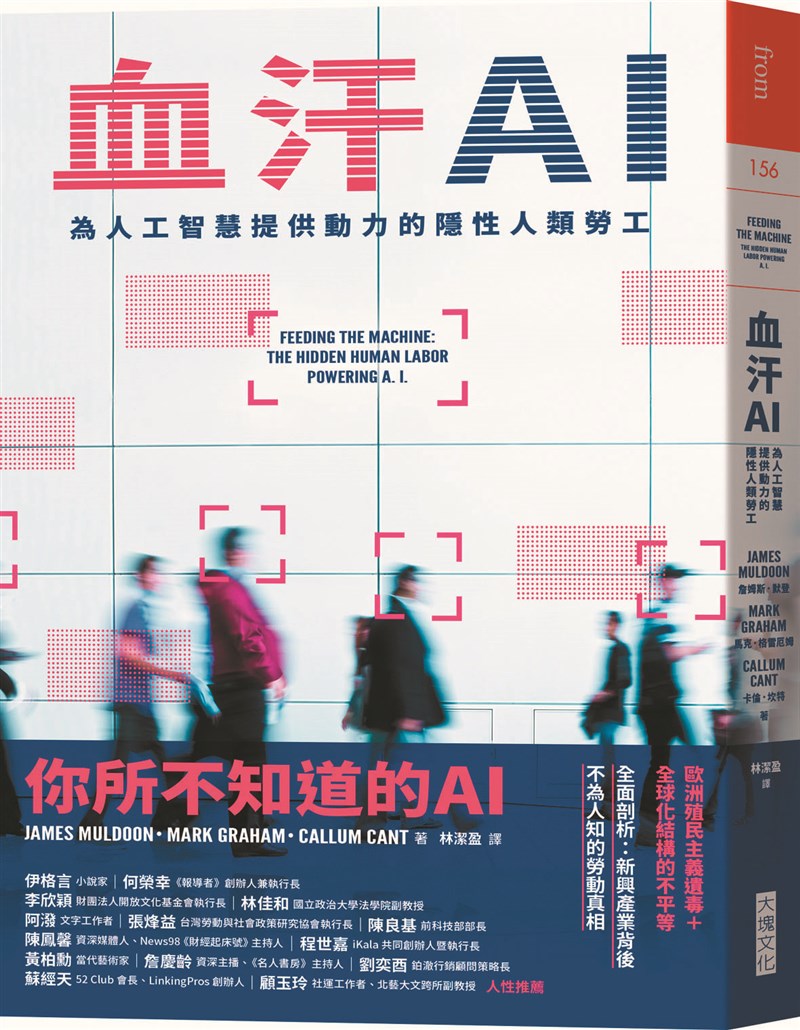

《血汗AI:為人工智慧提供動力的隱性人類勞工》

圖/大塊文化提供

《血汗AI:為人工智慧提供動力的隱性人類勞工》

圖/大塊文化提供

文/歐尼爾

《血汗AI》由任職牛津大學網路研究所的三位科技暨政治研究員合撰,他們隸屬於「AI公平工作」計畫,該計畫深入了解工人如何為建置人工智慧系統出力,目標是想改善這些勞工的工作條件。

馬克是教授兼計畫主持人,詹姆斯與卡倫是計畫研究專員兼大學講師,三人的背景涵蓋哲學、法律、地理學、政治學、社會學,為了探究「公平工作」,撰寫跨國際的人類勞動力驅動人工智慧的故事。

他們對從事機器學習演算法工程師、內容審核員、資料標註員、人工智慧倫理學家、勞工組織者、倉庫工人、業界人士等職業進行兩百多個專訪,選出七個產業的關鍵角色,從中挖掘被大眾忽略的數位工作者的故事、揭露全球不平等的權力系統、梳理出人工智慧運營的歷史脈絡,將長期的種族與性別剝削、人工智慧系統的技術發展連結起來,並且提出可行的建議,幫助跨國工人捍衛自己權益,實現公正公平的工作未來。

保住飯碗養家餬口

人工智慧的生成仰賴數位勞動力的國際分工。最理想、高薪、穩定的工作集中在美國各大城市,而最危險、低薪又不穩定的工作則外包到全球南方國家的周邊地區。非洲、印度、菲律賓等地的企業爭取從北美、歐洲外包出來的後台工作。位於東非的資料標註中心的員工,需要花大量時間在電腦前,手動搜尋社群貼文,刪除惡意內容,給資料貼上標籤供演算法使用,並且兼顧速度與準確性才能達到每天的工作目標,未能達成目標的話,就要無償加班。

這些標註員多半簽下沒有保障的短期聘雇契約,長期生活在恐懼中──如果無法達成雇主目標,可能無法續約。在這樣不牢靠的環境,濫用權力的可能性會增加,女性標註員尤其面臨的風險更高。這些工人在壓迫性的監視下做高強度的工作,只為了保住飯碗來養家餬口。

藝術家面臨的挑戰

除了身體勞動,人工智慧也吸收我們的集體智慧,如果將人工智慧理解為一台擷取機器,我們就是原料。比如科技公司可能透過一些不道德但並不違法的方式「永久」擁有配音員的聲音,再賣給其他公司使用。這些配音員將與一個合成版又價格低廉的自己競爭工作。

人工智慧公司甚至未經藝術家同意,使用仍受版權保護的在世藝術家作品來訓練人工智慧模型。這樣的圖像生成器讓任何人都能模仿藝術家風格,且不需要支付報酬給創作者,使得藝術家生計受影響。

人工智慧洗劫整個社群的創意、降低作品價值、竊取創意人士的身分,還可能取代創作者。藝術工作的報酬已經很低了,大量藝術家如果從市場消失,意味只有富裕家庭的孩子才能投身藝術。好萊塢的美國演員工會試著在合約談判中保護成員不會因生成式人工智慧而損失收入,不過達成協議的條款也存在著模糊兩可之處,存在著許多可能被製片公司利用的法律漏洞。

改變需要集體力量

作者建議工人要發揮集體力量,加入工會,並讓工人選出的代表參與公司層級的決策。消費者與社會運動也可把握時機向公司施壓,以改善整條供應鏈所有工人的工作與薪資條件。

這本書幫助讀者了解人工智慧協助少數科技業巨頭更進一步將塑造未來的能力、財富與權力都集中在他們手上。隱形勞動力為這巨大的人工智慧系統作出貢獻,不過權力者卻刻意掩蓋這些背後付出的勞動者。即使我們不一定會成為被壓榨的資料編註員,影響那些勞動力的機器,同樣也會影響大家的工作與日常。

只有透過團結,才有辦法改變這個只服務數位經濟的權貴階級的不公正制度,扭轉人工智慧將社會偏見嵌入新的數位歧視形式。眾人該讓這些科技巨頭意識到:除非我們自由,不然擷取機器將無法運轉。