圖/Kimi

圖/Kimi

文/檸檬

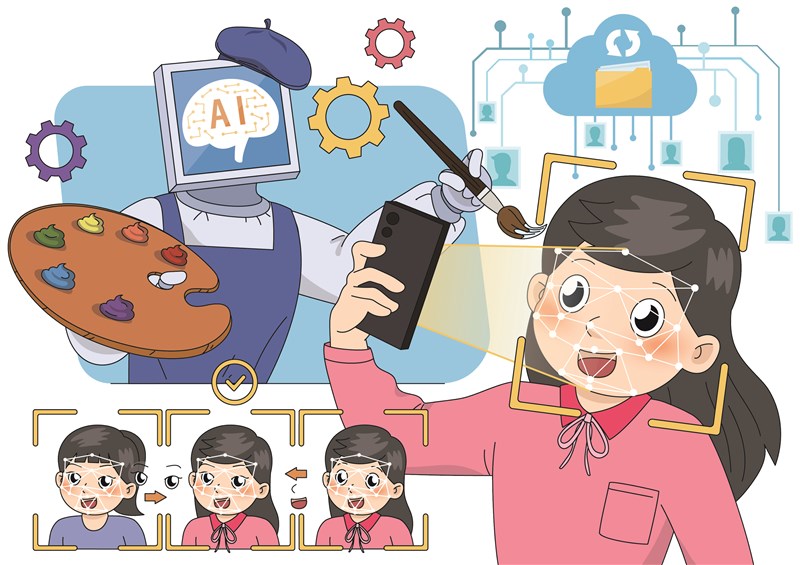

近年來,Deepfake(深度偽造)技術讓人開始懷疑,影像裡的人到底是不是本人?我們從小習慣相信「看到的就是真的」,但現在的AI能模仿表情、聲音,甚至是憤怒或悲傷的情緒。更嚴肅的是,這項技術還被濫用在製作名人或素人的不當影像,引發社會與法律討論。

特徵密碼 比對修改

Deepfake的原理看似複雜,其實核心之一與數學概念有關,差多少、距離近不近,也就是絕對值的延伸。在電腦裡,臉是一組非常長的「特徵密碼」。亮度、顏色與邊緣線條……等都各是一串數字,每張臉都有自己的超長密碼,而換臉技術的第一步,就是讀懂這些密碼。電腦會透過「編碼器」同時學習A與B的臉,經過成千上萬次的比對,它會逐漸看出規律,A的眼睛比較圓、B的臉頰比較亮;A的眉毛較粗、B的下巴更尖。每看一張圖片,電腦就更了解這兩張臉的差異。

接下來的「解碼器」就像兩位美術學生,一位專門練習畫A的臉,一位專門畫B的臉。它們不斷重複同樣的動作:分析、繪製、修正。每次畫得不像,系統就計算「差多少」並調整畫法。這些差異的比較方式,本質就像在算絕對值,但不是比一個數字,而是比成千上萬個特徵。眼睛位置差多少、亮度差多少、輪廓差多少,每一項就像是一個小小的「|真實數字-AI數字|」(絕對值),全部差異加總,就是AI的「誤差分數」。誤差大,就代表畫得不夠像;誤差小,就代表愈來愈接近真實。

Deepfake的關鍵魔術發生在下一步,電腦把A的臉丟進編碼器,得到A的特徵密碼,但在畫回臉時,它不是請「畫A的美術生」出手,而是請「畫B的美術生」動筆。於是畫出來的結果是B的臉,但帶著A的表情與動作。

差異變小 趨近逼真

要讓這個結果變得更有信度,AI必須持續把誤差減到極小。而學校學過的距離概念在這裡恰好能提供直覺。算|80-65|這種距離的概念,被延伸到數萬個臉部細節。AI的目標,就是把所有差距調小。可以把整個訓練想成一個不斷修正的循環,AI先畫,再比較、再修。

在更進階的階段,Deepfake會加入「生成對抗網路」(GAN)。這就像安排了一場對抗賽,一個AI是畫家,負責畫假的臉;另一個AI是檢查員,負責挑出不自然之處。畫家每畫一次,檢查員就會指出問題,例如光影怪異、邊緣突兀、反光不一致。畫家於是再修,檢查員也在抓錯中變得更敏銳。兩者互相逼迫、持續進步,最後達到幾可亂真的程度。

在影像愈來愈容易被修改的今天,理解這類技術背後的邏輯變得更重要。知道影像可以被偽造,也知道逼真並不是「真」,只是「差異變小」。當我們理解這些差異是經過大量計算、比較與修正後才縮小的,就能在真假交錯的世界裡保持判斷能力。