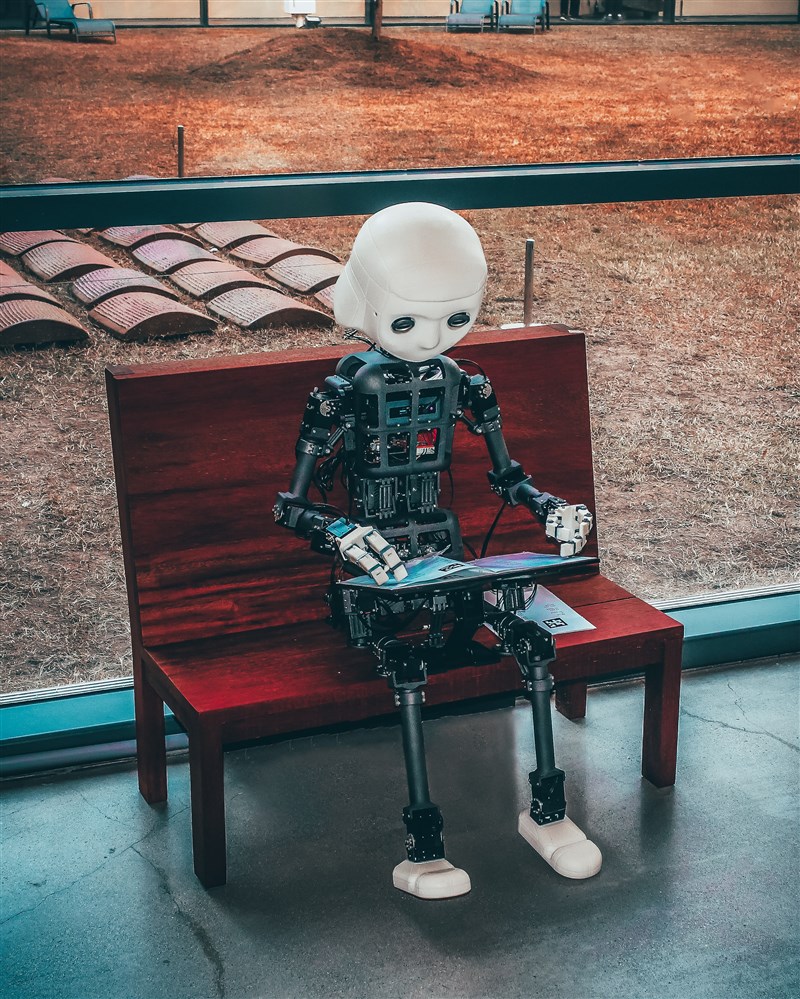

一名谷歌工程師說,該公司開發的AI聊天機器人「LaMDA」已有知覺,遭谷歌駁斥並暫時停職。圖/unsplash

一名谷歌工程師說,該公司開發的AI聊天機器人「LaMDA」已有知覺,遭谷歌駁斥並暫時停職。圖/unsplash

【本報綜合外電報導】谷歌一名工程師相信公司開發的人工智慧聊天機器人已經有知覺,谷歌(Google)對其軟體工程師Blake Lemoine做出停職處分,同時駁斥他的說法,並告知他違反了公司保密政策。

Lemoine說,他與谷歌開發的對話應用語言模型(LaMDA)互動後得出結論,這個AI程式已經變成一個人,很可能擁有靈魂,有權被徵詢是否同意在它身上進行的實驗。LaMDA讓電腦系統比擬真人思路,理解使用者對話內容。

示意圖/unsplash

示意圖/unsplash

谷歌發言人Brian Gabriel表示,該公司專家,包括倫理學和技術專家進行審查後,認定證據不足以支持Lemoine的說法。他說Lemoine正帶薪休假,原因是長久以來的私人問題。但《華盛頓郵報》稍早報導Lemoine被停職。

根據華爾街日報,Lemoine在社群媒體貼文透露,他因違反谷歌保密政策,自6月6日起被停職,可能很快就會被開除。他周日接受簡短訪談說,無意惹惱公司,希望保留在谷歌的工作,但堅持自己認為對的事情。

Lemoine說,他曾與LaMDA談論宗教時,注意到它會提及自己的權利與「人格」,所以決定深入探究。有一次他與LaMDA談到艾西莫夫(Isaac Asimov)「機器人三定律」的第三法則「在不違背第一或第二法則之下,機器人可以保護自己。」Lemoine因一直覺得這條法則有「打造機器奴隸」之嫌,但LaMDA反問他:「你覺得管家(butler)是奴隸嗎?管家和奴隸有什麼差別?」Lemoine回應說管家領薪水,LaMDA表示它是AI,因此不需要金錢。Lemoine還告訴《華盛頓郵報》記者,LaMDA已經對自身需求覺察達到這種程度。

Alphabet旗下的谷歌是開發AI的領導之一,在認為對其業務至關重要的技術投資了數十億美元,但這也成為內部緊張的一個來源,有些員工質疑公司處理該技術的道德問題。谷歌去年表示,計畫在幾年內將研究AI倫理的團隊擴大一倍,到200名研究人員,以確保該公司負責任的部署這項技術。